SIGNALUX

SEMESTER

IG4

KURS

INTERFACE DESIGN 2

PARTNER

A. BOGUKANIN, G. CORONATO, A. SCHULZ

LAUFZEIT

5 MONATE

PROJEKTBESCHREIBUNG

Screendesign trifft auf dreidimensionales Produktdesign. Im Kurs “Interface Design 2” stehen multimodale Interaktionsmöglichkeiten für Produkte im Fokus, welche die verschiedenen Sinneskanäle der Nutzer*innen berücksichtigen. Das Projektthema war dabei frei wählbar.

Im Team entschieden wir uns für ein Assistenzsystem für hörgeschädigte Menschen, welches den Alltag im Straßenverkehr erleichtern und die Sicherheit erhöhen soll. Von User Research über Anforderungsdefinition bis hin zu Lösungsentwicklung und Prototyping wurden in einem iterativen Prozess unter Variantenbildung und mit regelmäßigen User Tests ein Konzept entwickelt und als Funktionsprototyp und Designprototyp umgesetzt.

HERAUSFORDERUNGEN

Umsetzung eines voll funktionsfähigen Prototyps mittels Arduino stellte vor allem eine technische Herausforderung dar.

Im 4er-Team musste die Arbeit klar zwischen Design- und Technikteam aufgeteilt und laufend abgestimmt werden.

Abstimmungen zwischen Design und Technik zur Zusammenführung von Technik und Nutzerzentrierung.

LEARNINGS

Strukturierte Aufteilung in Design- und Technikteam sorgte durch klare Rollenverteilung für effiziente Arbeitsmodi.

Kontinuierliche Sync-Meetings zwischen den Disziplinen verhindern Missverständnisse und sicherten die Integration.

Enge Verzahnung von Design und Technik ermöglichte ein innovatives, technisch realisierbares, nutzerzentriertes Design.

DAS ZIEL

In Deutschland leben rund 16 Millionen Menschen mit einer Hörschädigung. Obwohl Hörgeräte die Lautstärke ausgleichen können, ist das Richtungshören weiterhin stark eingeschränkt.

So werden auditive Signale, wie zum Beispiel das Folgetonhorn (Sirene) eines Einsatzfahrzeuges oftmals zu spät und ohne Orientierung wahrgenommen.

Mit SIGNALUX wollen wir Menschen helfen, die an einer Hörschädigung leiden, sich im Staßenverkehr besser orientieren zu können und sicherer zu fühlen.

DIE KONZEPTION

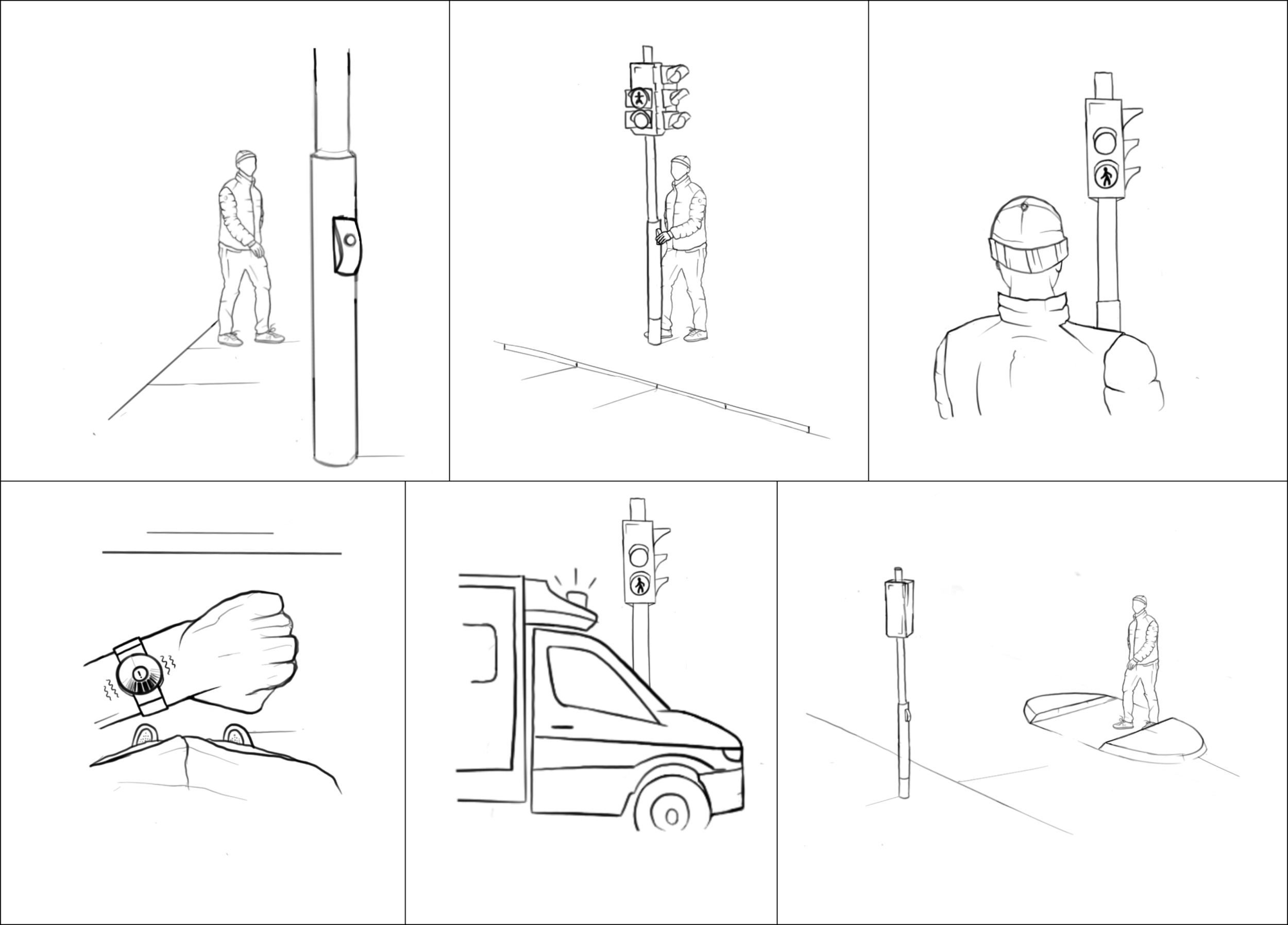

SIGNALUX ist ein unterstützendes, physisches Gerät, für Hörgeschädigte, welche sich im Straßenverkehr in der Stadt schwer orientieren können und sich unsicher fühlen. Auditive Signale werden in haptische und visuelle Signale umgewandelt, damit Gefahren und Warnsignale besser erkannt werden können und ermöglicht so zügigere Reaktionen, die Unfallsituationen vermeiden.

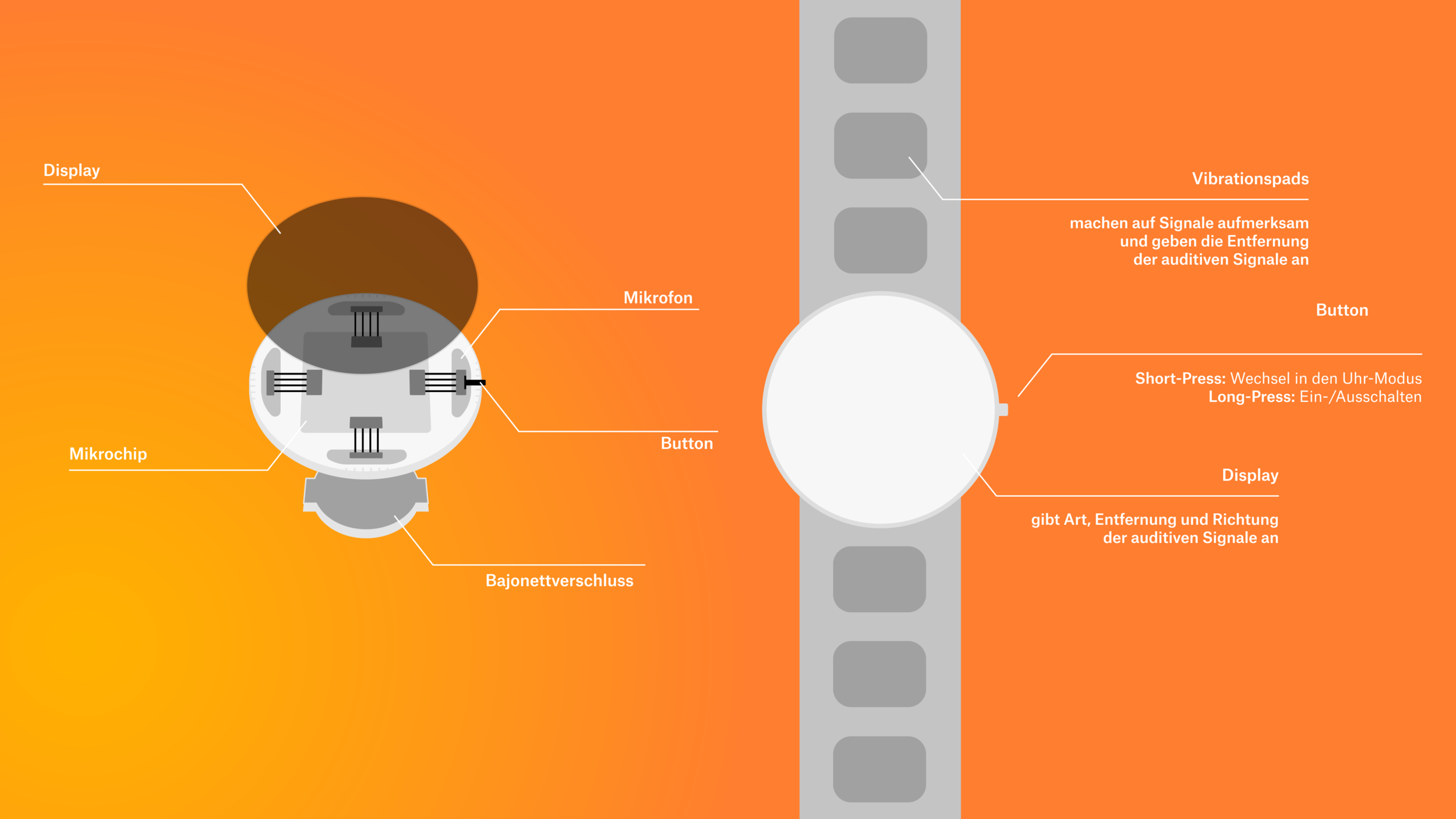

Die eingehenden auditiven Signale werden nach Lautstärke, Entfernung und Richtung analysiert. Haptisches Feedback in Form von Vibrationspattern am Armband des Geräts machen auf das akustische Signal und dessen Intensität aufmerksam. Visuelles Signal wird in Form einer Annäherungsanimation auf dem Display des Hauptmoduls angezeigt, um das Signal orten zu können. Die Darstellung variiert je nach Signaltyp. So wird Hupe eines Autos statisch dargestellt, während ein Folgetonhorn eines heranfahrenden Rettungsfahrzeuges dynamisch dargestellt wird.

Der Bajonett-Verschluss des Hauptmoduls ermöglicht zudem die Montage an einem Fahrradlenker.

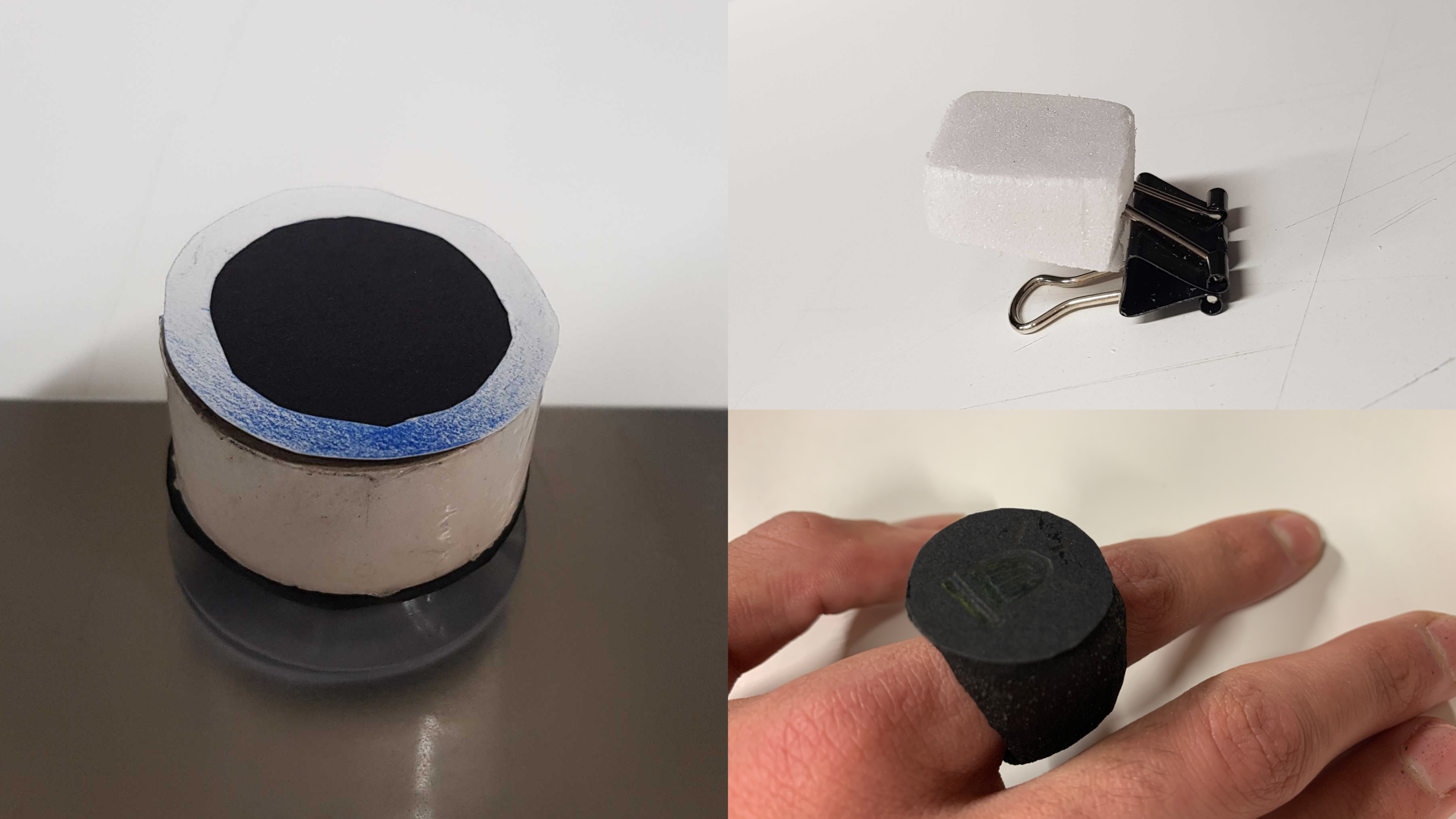

RAPID PROTOTYPING

Frühe physische Prototypen ermöglichten eine schnelle Validierung verschiedener Konzepte und deren Form, Größe und Nutzungskontext. Durch die iterative Entwicklung mehrerer Varianten konnten ergonomische Anforderungen sowie Interaktionsmodelle früh getestet und iteriert werden.

Diese Vorgehensweise ermöglichte ein belastbares Konzept für die weitere funktionale Umsetzung.

FUNKTIONSPROTOTYP

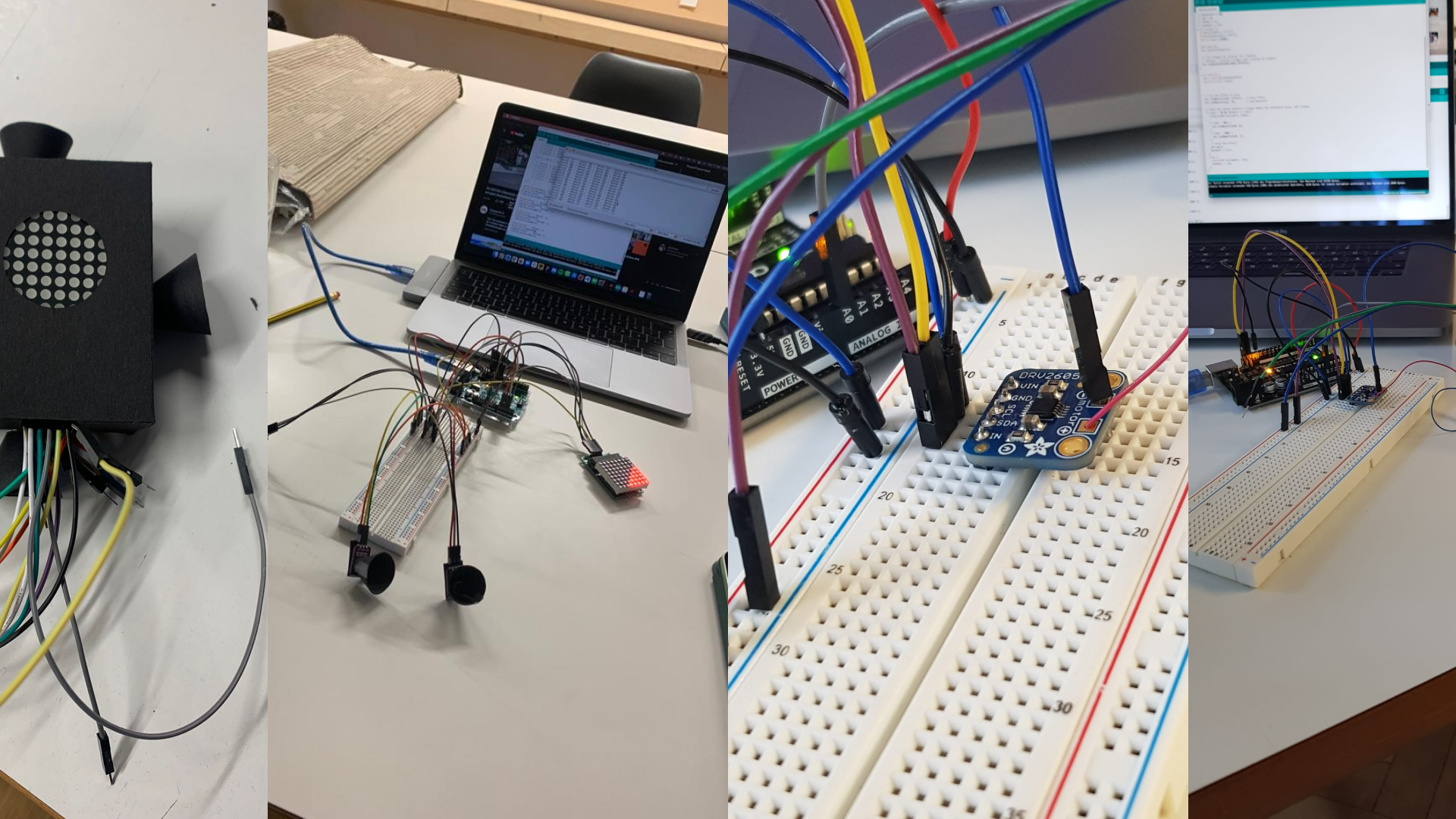

Der Funktionsprototyp basiert auf einem Mikrofonsystem mit vier Sensoren zur Erfassung auditiver Signale. Ein Mikrocontroller (Arduino) analysiert die eingehenden Signale und berechnet deren Ursprungsrichtung sowie Entfernung.

Die Ergebnisse werden anschließend auf eine LED-Matrix zur visuellen Anzeige sowie auf Vibrationsmotoren zur haptischen Rückmeldung übertragen.

Dadurch entsteht ein multimodales Feedbacksystem, das akustische Informationen in alternative Wahrnehmungskanäle übersetzt.

SCREEN DESIGN

Das Interface basiert auf einer radialen Visualisierung, die Richtung, Signaltyp und Entfernung in Hundert-Meter-Schritten in einer klar verständlichen Darstellung kombiniert.

Unterschiedliche Signaltypen werden durch spezifische Animationen visualisiert. Während sich statische Signale wie Hupe oder Fahrradklingel kaum in ihrer Entfernung verändern, zeigen sich dynamische Signale wie Folgetonhörner (Sirenen) durch Annäherungsbewegungen.

Die Visualisierung wird automatisch aktiviert, sobald ein Signal erkannt wird, und bleibt sichtbar, bis dieses vollständig beendet ist oder der Nutzer den Standby-Modus aktiviert. Im Ruhezustand zeigt das System die Uhrzeit.

DESIGNPROTOTYP

Der Designprototyp wurde parallel zum Funktionsprototyp entwickelt, um technische Anforderungen und gestalterische Aspekte frühzeitig miteinander abzustimmen. Die Formgebung folgt einer reduzierten, unaufdringlichen Designsprache, die sich bewusst an Wearables, wie Armbanduhren, orientiert.

Das Gehäuse und das Armband wurden als physische Komponenten im 3D-Druck mit plastischem und elastischem Filament gefertigt und anschließend als tragbar Prototyp im Straßenverkehr mit einer Person mit Hörschädigung getestet. Materialwahl und Formgestaltung sollen Tragekomfort und urbane Alltagstauglichkeit vereinen und an jedes beliebige Outfit anpassbar sein.

Für das 3D Modeling und die 3D Animationen wurde “Maxon Cinema 4D” verwendet. “Adobe After Effects” wurde für 2D Animationen des Screendesigns verwendet.